隨著數字經濟的快速發展,大數據已成為企業決策和業務優化的核心驅動力。本文將系統介紹大數據處理與運維的知識路徑,并結合實戰項目合集,幫助讀者構建從理論到實踐的全棧能力。

一、大數據處理的核心技術路徑

- 數據采集與集成:學習使用Flume、Kafka等工具,實現多源數據的實時采集與傳輸。

- 數據存儲與管理:掌握HDFS、HBase、Hive等分布式存儲技術,構建高效的數據倉庫。

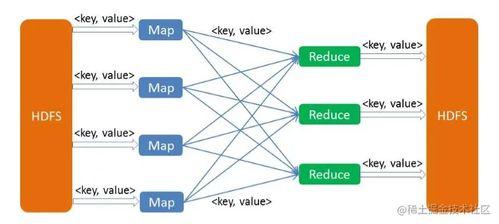

- 數據處理與分析:深入理解MapReduce、Spark、Flink等計算框架,實現批處理與流式數據處理。

- 數據可視化與應用:通過Tableau、Superset等工具,將分析結果轉化為直觀的可視化報告。

二、大數據運維服務的關鍵領域

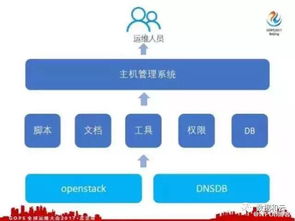

- 集群部署與監控:使用Ambari、Cloudera Manager等工具,實現Hadoop生態組件的自動化部署與性能監控。

- 資源調度與優化:學習YARN、Kubernetes等資源管理器,確保計算資源的高效利用。

- 安全與權限管理:實施Kerberos認證、Ranger授權等機制,保障數據安全與合規性。

- 故障排查與容災:建立日志分析、備份恢復體系,提升系統穩定性與可用性。

三、實戰項目合集

- 電商用戶行為分析平臺:基于Spark Streaming處理實時用戶點擊流,結合Hive進行離線分析,輸出用戶畫像與推薦策略。

- 物聯網設備監控系統:利用Flink處理傳感器數據流,通過Elasticsearch實現異常檢測與告警,并通過Grafana展示監控儀表盤。

- 金融風控數據管道:構建Kafka至Hive的數據管道,集成Spark MLlib進行欺詐檢測,并利用Airflow調度每日批處理任務。

- 日志聚合與運維分析:部署ELK棧(Elasticsearch、Logstash、Kibana),實現分布式系統日志的收集、分析與可視化。

四、學習建議與職業發展

- 初學者可從Hadoop基礎入手,逐步擴展至Spark、Flink等高級框架。

- 參與開源項目或企業實習,積累實戰經驗。

- 關注云原生大數據服務(如AWS EMR、Azure HDInsight),提升運維自動化技能。

大數據處理與運維是一個持續演進的領域,通過系統學習技術路徑并完成實戰項目,讀者將能夠勝任數據工程師、運維工程師等崗位,為企業數據驅動轉型提供堅實支撐。